はじめに

Wan 2.1 I2V-14B-480P を5bit量子化したモデルを利用し、ローカル環境(ノートPC)にて写真からビデオを生成してみました。

1. Wan 2.1とは

アリババのWan 2.1 は、画像や動画を生成するための高度なAIモデルです。このモデルは、アリババグループのTongyi Labによって開発され、2025年2月に一部がオープンソース化されました。Wan 2.1は、テキストから画像や動画を生成する機能を持ち、特にマルチオブジェクトの相互作用を正確に表現する能力が高く評価されています。

1.1. 主な特徴

- オープンソース化 : Wan 2.1の4つのバリアント(T2V-1.3B、T2V-14B、I2V-14B-720P、I2V-14B-480P)が公開されており、開発者や研究者が利用可能です。

- 高性能 : 特に「14B」モデルは140億パラメーターを持ち、VBenchランキングでトップの成績を収めています。

- 多様なタスク対応 : テキストから動画、画像から動画、動画編集など多様なタスクに対応しています。

- 低リソース要件 : 軽量版のT2V-1.3Bモデルはわずか8.19GBのVRAMで動作可能で、一般的なGPUでも使用できます。

今回は、I2V-14B-480Pのモデルを5bit量子化したGGUFモデルを使い、ノートPC(VRAM 8GB)で画像からビデオを生成(I2V)してみます。

2. 検証PCのスペック

Operating System: Windows 11 Pro 64-bit (10.0, Build 26100) (26100.ge_release.240331-1435)

Processor: 12th Gen Intel(R) Core(TM) i7-12700H (20 CPUs), ~2.7GHz

Memory: 32768MB RAM

Card name: NVIDIA RTX A2000 8GB Laptop GPU

3. ComfyUI環境構築

ComfyUI用に公開されているフローを利用します。

ComfyUIは最新バージョンにアップデートしてください。

下記サイトより次のファイルをダウンロードします。

- umt5_xxl_fp8_e4m3fn_scaled.safetensors

- wan_2.1_vae.safetensors

- clip_vision_h.safetensors

- Image to Video Workflow in Json format

また、下記ページより量子化されたGGUFモデルのいずれかをダウンロードします。

今回は、「wan2.1-i2v-14b-480p-Q5_K_M.gguf」を利用しました。

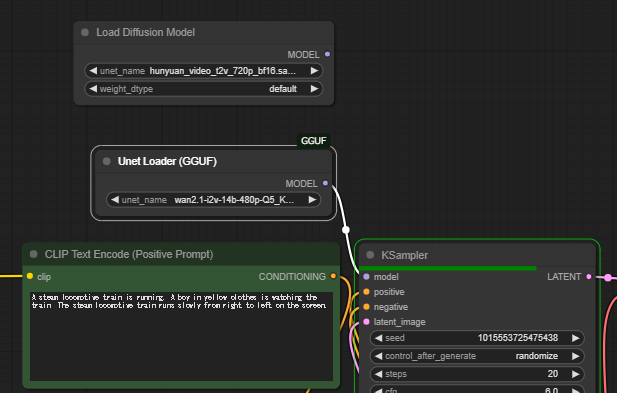

4. ComfyUIフローの変更

先ほどダウンロードしたフローは、GGUFモデル読み込みに対応していないため、「Load Deffusion Model」ノードを「Unet Loader(GGUF)」ノードに差し替えます。

Unet Loader(GGUF)がインストールされていない場合には、Custom Node Managerから「ComfyUI-GGUF」を検索し、インストールします。インストール後はComfyUIをリスタートしてください。

5. ビデオの生成

サンプルを参照すると生成サイズとして 512 x 512 pxに指定されていますが、必ずしもこのサイズではなくても生成可能なようです。

Wan 2.1 内部では 832 x 480 px で処理されているとの情報があったので、今回はこのサイズを指定しました。

49フレーム(3秒)の生成時間は40分でした。

5.1. 元画像

5.2. 指定したプロンプト

A steam locomotive train is running. A boy in yellow clothes is watching the train. The steam locomotive train runs slowly from right to left on the screen.蒸気機関車が走っています。黄色の服を着た少年が列車を見ています。蒸気機関車は画面の右から左へゆっくりと走ります。

6. 追加作品

6.1. 元画像

6.2. 生成動画

7. FAQ

- Wan 2.1 I2V-14B-480Pの最小システム要件は何ですか?

- 5bit量子化モデルを使用する場合、8GB VRAMのGPUを搭載したPCで動作可能です。

- Wan 2.1 GGUFモデルをComfyUIにて使用するために必要な追加手順はありますか?

- はい。Custom Node Managerから「ComfyUI-GGUF」をインストールし、「Unet Loader(GGUF)」ノードを使用する必要があります。

- 動画生成にかかる時間はどのくらいですか?

- 今回の構成の場合、49フレーム(3秒)の生成に40分かかりました。